برلين - سبأ:

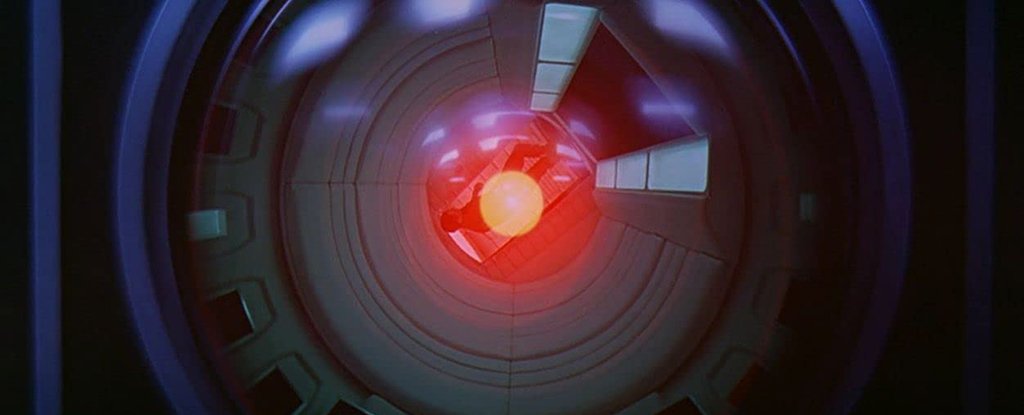

لقد تم الحديث عن فكرة الإطاحة بالذكاء الاصطناعي للبشرية منذ عقود ، وفي عام 2021 ، أصدر العلماء حكمهم حول ما إذا كنا سنكون قادرين على التحكم في ذكاء فائق للكمبيوتر عالي المستوى. الاجابة؟ تقريبا بالتأكيد لا.

والمهم هو أن التحكم في ذكاء خارق يتجاوز بكثير الفهم البشري يتطلب محاكاة لذلك الذكاء الفائق الذي يمكننا تحليله (والتحكم فيه). ولكن إذا كنا غير قادرين على فهمها ، فمن المستحيل إنشاء مثل هذه المحاكاة.

ولا يمكن وضع قواعد مثل "لا تسبب ضررًا للبشر" إذا لم نفهم نوع السيناريوهات التي سيأتي بها الذكاء الاصطناعي ، كما يقترح معدو الدراسة الجديدة. وبمجرد أن يعمل نظام الكمبيوتر على مستوى أعلى من نطاق المبرمجين لدينا ، لم يعد بإمكاننا وضع حدود.

وكتب الباحثون: "إن الذكاء الخارق يطرح مشكلة مختلفة اختلافًا جوهريًا عن تلك التي تدرس عادةً تحت شعار" أخلاقيات الروبوت " ... وهذا لأن الذكاء الخارق متعدد الأوجه ، وبالتالي يحتمل أن يكون قادرًا على تعبئة مجموعة متنوعة من الموارد من أجل تحقيق أهداف يحتمل أن تكون غير مفهومة للبشر ، ناهيك عن التحكم فيها."

وجاء جزء من استدلال الفريق من مشكلة التوقف التي طرحها آلان تورينج في عام 1936. وتتركز المشكلة على معرفة ما إذا كان برنامج الكمبيوتر سيصل إلى نتيجة وإجابة أم لا (لذلك يتوقف) ، أو أنه ببساطة سيعقد إلى الأبد في محاولة للعثور على واحدة.

وكما أثبت تورينج من خلال بعض الرياضيات الذكية ، بينما يمكننا أن نعرف أنه بالنسبة لبعض البرامج المحددة ، من المستحيل منطقيًا إيجاد طريقة تسمح لنا بمعرفة ذلك لكل برنامج محتمل يمكن كتابته في أي وقت. هذا يعيدنا إلى الذكاء الاصطناعي ، والذي في حالة فائقة الذكاء يمكنه عمليا الاحتفاظ بكل برنامج كمبيوتر ممكن في ذاكرته في وقت واحد.

وأي برنامج مكتوب لمنع الذكاء الاصطناعي من إلحاق الأذى بالبشر وتدمير العالم ، على سبيل المثال ، قد يصل إلى نتيجة (ويتوقف) أم لا - من المستحيل رياضياً أن نتأكد تمامًا من أيٍّ من الحالتين ، مما يعني أنه غير قابل للاحتواء.

وقال عالم الكمبيوتر إياد رهوان من معهد ماكس بلانك للتنمية البشرية في ألمانيا في عام 2021 : "في الواقع ، هذا يجعل خوارزمية الاحتواء غير قابلة للاستخدام" .

وقال الباحثون إن البديل لتعليم الذكاء الاصطناعي بعض الأخلاقيات وإخباره بعدم تدمير العالم - وهو أمر لا يمكن لأي خوارزمية أن تكون متأكدة تمامًا من القيام به - هو الحد من قدرات الذكاء الفائق. يمكن قطعها عن أجزاء من الإنترنت أو من شبكات معينة ، على سبيل المثال.

ورفضت الدراسة هذه التي نشرت في مجلة الذكاء الاصطناعي الفكرة أيضًا ، مشيرة إلى أنها ستحد من وصول الذكاء الاصطناعي ؛ تقول الحجة أنه إذا كنا لن نستخدمها لحل مشاكل خارج نطاق البشر ، فلماذا نخلقها على الإطلاق؟

وإذا كنا سنمضي قدمًا في الذكاء الاصطناعي ، فقد لا نعرف حتى متى يصل ذكاء خارق خارج عن سيطرتنا ، وهذا هو عدم فهمه. هذا يعني أننا بحاجة إلى البدء في طرح بعض الأسئلة الجادة حول الاتجاهات التي نسير فيها.

وقال عالم الكمبيوتر مانويل سيبريان من معهد ماكس بلانك للتنمية البشرية ، في عام 2021 أيضًا: " تبدو الآلة فائقة الذكاء التي تتحكم في العالم مثل الخيال العلمي. ولكن هناك بالفعل آلات تؤدي مهامًا مهمة معينة بشكل مستقل دون وجود مبرمجين بشكل كامل. فهم كيف تعلموها ".

ولذلك فإن السؤال الذي يطرح نفسه هو ما إذا كان هذا يمكن أن يصبح في مرحلة ما خارج نطاق السيطرة وخطيرًا على البشرية.

لقد تم الحديث عن فكرة الإطاحة بالذكاء الاصطناعي للبشرية منذ عقود ، وفي عام 2021 ، أصدر العلماء حكمهم حول ما إذا كنا سنكون قادرين على التحكم في ذكاء فائق للكمبيوتر عالي المستوى. الاجابة؟ تقريبا بالتأكيد لا.

والمهم هو أن التحكم في ذكاء خارق يتجاوز بكثير الفهم البشري يتطلب محاكاة لذلك الذكاء الفائق الذي يمكننا تحليله (والتحكم فيه). ولكن إذا كنا غير قادرين على فهمها ، فمن المستحيل إنشاء مثل هذه المحاكاة.

ولا يمكن وضع قواعد مثل "لا تسبب ضررًا للبشر" إذا لم نفهم نوع السيناريوهات التي سيأتي بها الذكاء الاصطناعي ، كما يقترح معدو الدراسة الجديدة. وبمجرد أن يعمل نظام الكمبيوتر على مستوى أعلى من نطاق المبرمجين لدينا ، لم يعد بإمكاننا وضع حدود.

وكتب الباحثون: "إن الذكاء الخارق يطرح مشكلة مختلفة اختلافًا جوهريًا عن تلك التي تدرس عادةً تحت شعار" أخلاقيات الروبوت " ... وهذا لأن الذكاء الخارق متعدد الأوجه ، وبالتالي يحتمل أن يكون قادرًا على تعبئة مجموعة متنوعة من الموارد من أجل تحقيق أهداف يحتمل أن تكون غير مفهومة للبشر ، ناهيك عن التحكم فيها."

وجاء جزء من استدلال الفريق من مشكلة التوقف التي طرحها آلان تورينج في عام 1936. وتتركز المشكلة على معرفة ما إذا كان برنامج الكمبيوتر سيصل إلى نتيجة وإجابة أم لا (لذلك يتوقف) ، أو أنه ببساطة سيعقد إلى الأبد في محاولة للعثور على واحدة.

وكما أثبت تورينج من خلال بعض الرياضيات الذكية ، بينما يمكننا أن نعرف أنه بالنسبة لبعض البرامج المحددة ، من المستحيل منطقيًا إيجاد طريقة تسمح لنا بمعرفة ذلك لكل برنامج محتمل يمكن كتابته في أي وقت. هذا يعيدنا إلى الذكاء الاصطناعي ، والذي في حالة فائقة الذكاء يمكنه عمليا الاحتفاظ بكل برنامج كمبيوتر ممكن في ذاكرته في وقت واحد.

وأي برنامج مكتوب لمنع الذكاء الاصطناعي من إلحاق الأذى بالبشر وتدمير العالم ، على سبيل المثال ، قد يصل إلى نتيجة (ويتوقف) أم لا - من المستحيل رياضياً أن نتأكد تمامًا من أيٍّ من الحالتين ، مما يعني أنه غير قابل للاحتواء.

وقال عالم الكمبيوتر إياد رهوان من معهد ماكس بلانك للتنمية البشرية في ألمانيا في عام 2021 : "في الواقع ، هذا يجعل خوارزمية الاحتواء غير قابلة للاستخدام" .

وقال الباحثون إن البديل لتعليم الذكاء الاصطناعي بعض الأخلاقيات وإخباره بعدم تدمير العالم - وهو أمر لا يمكن لأي خوارزمية أن تكون متأكدة تمامًا من القيام به - هو الحد من قدرات الذكاء الفائق. يمكن قطعها عن أجزاء من الإنترنت أو من شبكات معينة ، على سبيل المثال.

ورفضت الدراسة هذه التي نشرت في مجلة الذكاء الاصطناعي الفكرة أيضًا ، مشيرة إلى أنها ستحد من وصول الذكاء الاصطناعي ؛ تقول الحجة أنه إذا كنا لن نستخدمها لحل مشاكل خارج نطاق البشر ، فلماذا نخلقها على الإطلاق؟

وإذا كنا سنمضي قدمًا في الذكاء الاصطناعي ، فقد لا نعرف حتى متى يصل ذكاء خارق خارج عن سيطرتنا ، وهذا هو عدم فهمه. هذا يعني أننا بحاجة إلى البدء في طرح بعض الأسئلة الجادة حول الاتجاهات التي نسير فيها.

وقال عالم الكمبيوتر مانويل سيبريان من معهد ماكس بلانك للتنمية البشرية ، في عام 2021 أيضًا: " تبدو الآلة فائقة الذكاء التي تتحكم في العالم مثل الخيال العلمي. ولكن هناك بالفعل آلات تؤدي مهامًا مهمة معينة بشكل مستقل دون وجود مبرمجين بشكل كامل. فهم كيف تعلموها ".

ولذلك فإن السؤال الذي يطرح نفسه هو ما إذا كان هذا يمكن أن يصبح في مرحلة ما خارج نطاق السيطرة وخطيرًا على البشرية.